AI Articles

AI 領域精選文章翻譯

Anthropic 史上最大規模資料外洩:待發布的 Claude Mythos 完整曝光,Capybara 新 tier 確認存在

by The Decoder

摘要

- Anthropic 因 CMS 設定錯誤,意外將近 3,000 份內部文件暴露在公開可搜尋的資料庫中,包括一份尚未發布的 draft blog post,詳細介紹了名為「Claude Mythos」的新模型。

- Anthropic 已向 Fortune 證實正在測試這個新模型,並以「step change」與「公司史上最強」來形容其在推理、coding 與網路安全方面的能力。

- 新模型將屬於一個名為「Capybara」的全新 tier,位於現有 Opus 之上。這是 Claude 家族首次引入比 Opus 更高的產品定位。

- 洩露文件顯示,Capybara 在軟體 coding、學術推理與網路安全測試中的得分都「遠高於」Claude Opus 4.6,尤其網路安全能力被形容為「目前所有 AI 模型之冠」。

- Anthropic 坦言這個模型「對我們來說成本極高,對客戶來說也會非常昂貴」,因此採取比以往更謹慎的階段性發布策略,首波僅提供給早期 access 客戶做網路安全應用評估。

- 鬧劇級的諷刺:打造「史上最強網路安全 AI」的公司,因為最基本的 CMS 設定錯誤而讓這件事曝光。

3 月 26 日,Anthropic 的一次資料外洩事件,揭露了該公司內部稱為「公司史上最強大」的未發布 AI 模型。Fortune 率先報導此事件後,Anthropic 已證實正在與特定客戶共同測試該模型,聲稱這是推理、coding 與網路安全領域的「step change」。

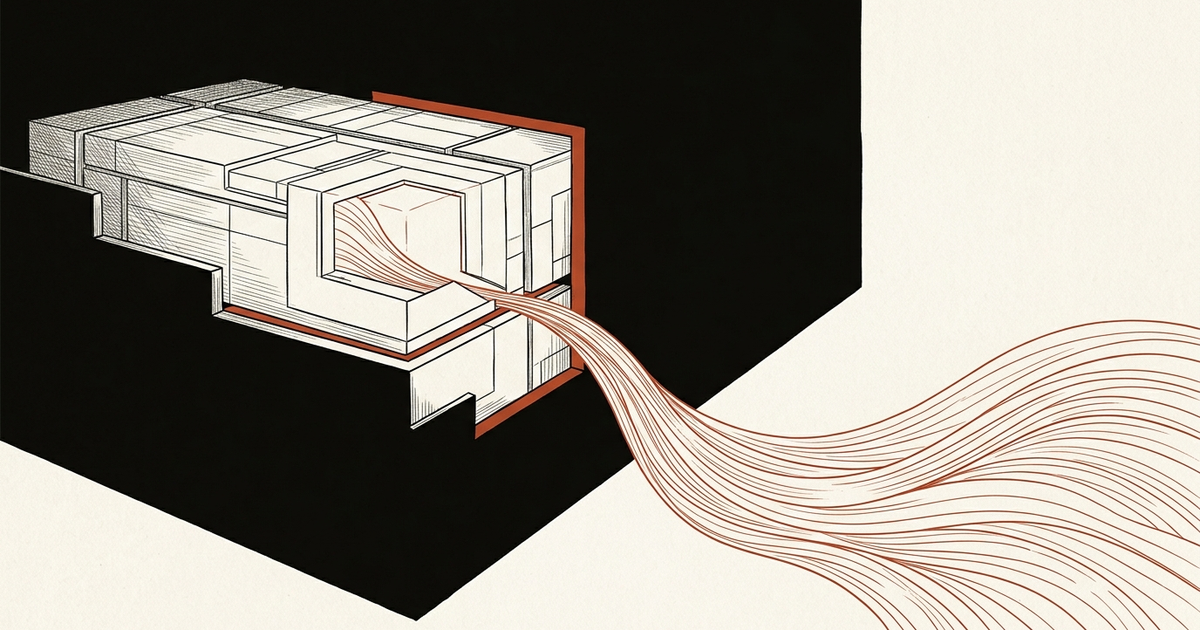

這次資料外洩的起因是 Anthropic 內容管理系統的設定錯誤。一個預設設定讓上傳的檔案自動變成公開存取,導致近 3,000 份內部文件暴露在公開可搜尋的資料庫中,任何人都可以查看。

洩露的 blog post 透露了什麼

根據 Fortune 看到並經過 Anthropic 證實的資料,洩露的 draft blog post 詳細介紹了這個代號為「Mythos」的新模型。文件顯示這是一份「幾乎準備好要發布」的公告,標題為「我們已完成史上最大規模 AI 模型的訓練」。

Anthropic 最終選擇了一個更具體的標題:「Introducing Claude Opus 4.6」,但內部仍在討論另一個更強大 tier 的產品名稱。

這份 draft 透露了更多細節:Anthropic 正在規劃一個名為「Capybara」的全新產品 tier。文件中寫道:「Capybara 是一個新 tier 的新名稱:比我們的 Opus 模型更大、更聰明——而 Opus 直到現在都是我們最強大的型號。」

文件還詳細說明了 Capybara 在多項關鍵基準測試中的表現:「與我們先前的最佳模型 Claude Opus 4.6 相比,Capybara 在軟體 coding、學術推理、網路安全等測試中都獲得了大幅更高的分數。」

Anthropic 發言人向 Fortune 證實:「我們正在開發一個通用模型,在推理、coding 與網路安全方面有實質性的進展。我們認為這個模型是一個『台階式的變化』,也是我們迄今為止打造的最強模型。」

值得注意的是,Anthropic 還在文件中描述了這個模型所帶來的獨特風險。根據 The Decoder 看到的文件副本,draft 中有一段警語:

「這個模型在網路安全方面的能力,目前遠超所有其他 AI 模型。我們認為它預示著接下來會有一波模型,它們利用漏洞的方式,將遠遠快於防守方的修補速度。」

這個警告讓同一天網路安全相關股票出現明顯下跌,市場似乎將其解讀為對現有資安產業的潛在威脅。

一個 tier,兩組命名

洩露文件最引人注目的細節之一,是 Anthropic 似乎同時在測試兩種不同的命名策略。

文件出現了兩個版本:一個將模型稱為「Claude Mythos」,另一個則稱為「Capybara」。兩個版本的核心內容幾乎相同,主要差異只在於產品名稱。

在 Capybara 版本中,這個名稱被替換到了標題和內文的各處,但副標題仍然寫著:「我們已完成一個新 AI 模型的訓練:Claude Mythos。」

兩個版本都使用了相同的命名由來說明,選擇這個名稱是為了唤起「連結知識與想法之間的深厚脈絡」這個意象。

Anthropic 告訴 Fortune,這份文件只是「正在考慮發布的早期草案內容」,顯示公司當時仍在為同一個模型決定最終的公開名稱。

目前尚不清楚這個模型最終會以「Mythos」、「Capybara」還是其他名稱問世。但可以確定的是,這會是一個比 Opus 更高級別的全新產品線。

OpenAI 也在蓄力:代號「Spud」

除了 Anthropic,OpenAI 也在準備一個代號為「Spud」的重大新模型發布。根據 The Decoder 報導,Sam Altman 已在內部將這個模型形容為具有「巨大能力躍升」,聲稱它可以「真正加速經濟發展」。

消息指出,Spud 已經完成預訓練階段,與 Anthropic 的 Mythos/Capybara 差不多處於同樣的發展節點。

此外,報導也提到,兩家公司都可能選擇時機,在各自預計於今年稍晚的 IPO 計劃前,針對這個最強模型的發布進行最佳化布局。

延伸評論:最強 AI 因最基本失誤而曝光,這件事本身就很有教育意義

Anthropic 正在打造一個被自己形容為「能比防守方更快利用漏洞」的 AI 模型,結果卻因為一個「預設設定讓上傳檔案自動公開」的低級錯誤,把即將發布的旗艦模型公告直接攤在公開資料庫裡。

這不是資安顧問在 PowerPoint 上會假設的那種「駭客入侵」或「零日漏洞」。這是一個任何 DevOps 工程師都可能做出來的設定疏失——而且偏偏發生在最不可能出包的時候。

諷刺之處還不只如此。Anthropic 是目前最強調 AI 安全與對齊的公司之一,員工名單裡有好幾位頂尖的 AI 安全研究者。他們的公關基調一向是「我們比別人更認真看待風險」。結果公司在安全宣示最高的時刻,因為最基礎的系統設定錯誤,暴露了近 3,000 份文件。

這件事對整個產業有幾層意涵。首先,所有實驗室都必須正視一個事實:產品與研究流程中的基礎設施失誤,可能比模型本身的能力躍進帶來更大的公關風險。其次,「我們是最安全的實驗室」這種敘事,在一次 CMS 設定錯誤面前幾乎毫無防禦力。最後,無論模型多強,只要有 CMS 的「預設公開」設定,攻擊者只需要會搜尋、不需要會 prompt injection。

對於正在觀望 Anthropic 新模型的人來說,這次洩露或許也提供了一個額外的參考點:除了評估模型能力,也許可以順便研究一下這家公司的基礎設施紀律。