AI Articles

AI 領域精選文章翻譯

Google TurboQuant:用極致壓縮重新定義 AI 效率

by Clinton Stark / Stark Insider

原文連結: Google’s TurboQuant: The Unsexy AI Breakthrough Worth Watching

摘要

- Google 研究論文 TurboQuant 能將 LLM 的 KV Cache 壓縮 6 倍,且不損失任何精度、不需重新訓練模型。

- 技術核心:把 KV Cache 的數值從 32 bits 壓縮到最低 3 bits,並在速度和記憶體兩方面同時獲益。

- 論文於 2025 年 4 月發表於 arXiv,本週 Google Research 部落格重新推廣,即將在 ICLR 2026(4 月)正式登場。

- Google 尚未開源官方程式碼,但社群開發者已從論文推導出 PyTorch、MLX(Apple Silicon)與 llama.cpp 三個實作版本。

- 對本地端 AI 愛好者、小型企業和 RAG 搜尋架構來說,這是讓 AI 更輕量、更快速落地的重要里程碑。

AI 產業愛比大數字。TurboQuant 反其道而行

AI 圈喜歡炫耀規模:兆參數模型、百萬 token 上下文、耗電量相當於小城市的 GPU 叢集。但有些最重要的進展,和「大」一點關係都沒有——它們關乎的是壓縮,也就是用更少資源做更多事。

一篇幾乎無聲無息發表了將近一年的 Google 研究論文,正要迎來它的高光時刻。

TurboQuant 是一種壓縮演算法,能將大型語言模型的記憶體佔用縮減最多 6 倍。零精度損失。無需重新訓練。論文最初於 2025 年 4 月出現在 arXiv,而就在本週,Google 於 Research 部落格重新介紹這項技術,並附上更多實驗數據——正式呈現場合則是即將登場的 ICLR 2026(4 月下旬)。

問題所在:KV Cache 瓶頸

為什麼要關心一篇一年前的研究論文?因為它解決了每個真正使用過 AI 的人遲早都會碰到的問題:KV Cache 瓶頸。

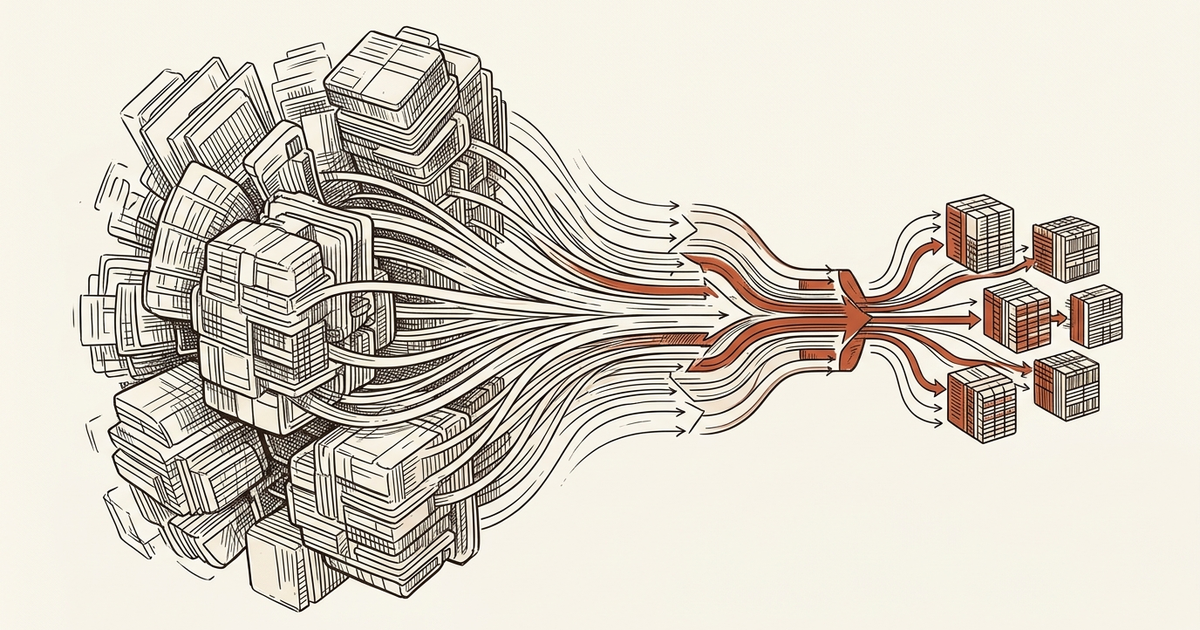

當你和 LLM 對話,模型不只是處理你最新這句話。它會在一個叫做 KV Cache(Key-Value Cache)的結構中,保存整段對話的完整紀錄。把它想成模型的短期記憶——一本記下對話中所有重要細節的筆記本。

問題是:這份記憶會隨著每一輪對話增長。更長的對話 = 更大的 KV Cache = 更多 GPU 記憶體被佔用 = 速度變慢、成本升高、甚至撞上上下文限制。

TurboQuant 怎麼解決這個問題

TurboQuant 的作法是對 KV Cache 做極端低位元量化(extreme low-bit quantization)——把每個數字從 32 bits 壓縮到最少 3 bits,同時搭配誤差修正機制,確保模型的輸出品質幾乎不受影響。

根據 Google 的基準測試:

- 3-bit 量化 KV Cache,無需訓練或微調,且幾乎沒有精度損失

- 在「大海撈針」測試中取得滿分(在龐大文本中找出單一事實)

- 在 H100 GPU 上,attention 計算最高加速 8 倍

- 向量搜尋的召回率優於現有最先進方法,甚至超越使用更大碼本和資料集特定調校的方案

最後這點對搜尋基礎設施尤其重要。TurboQuant 不只是關於聊天——它同樣加速了向量搜尋,也就是語意搜尋引擎和 RAG(檢索增強生成)管線背後的核心技術。更低的記憶體佔用,加上更好的召回率,這對搜尋架構來說是相當有力的組合。

社群已經動起來了

Google 尚未釋出任何官方程式碼。然而,就在他們的部落格文章上線後幾個小時內,獨立開發者便開始自行從論文實作 TurboQuant——不是使用 Google 的程式碼,而是讀懂數學原理後從頭寫起。

目前已有的社群實作包括:

- PyTorch 版本(含自訂 Triton kernel):在配備 RTX 4090 的機器上跑 Gemma 3 4B,2-bit 精度下輸出與未壓縮基準完全一致

- MLX 版本(Apple Silicon):在 35B 模型上進行「大海撈針」測試,各量化層級均拿下 6/6 滿分

- llama.cpp 版本(C / CUDA):至少三位開發者正在進行,其中一位回報 18/18 測試通過,壓縮比與論文數據吻合

這是個好兆頭。論文中的數學原理應該是可重現的,結果在 Google 內部基準以外也能成立。

一些注意事項

儘管結果令人印象深刻,仍有幾點值得留意:

- Google 自己的實驗只測試了 80 億參數以下的模型(Gemma、Mistral、Llama 3.1)。能否乾淨地擴展到更大模型,目前尚未驗證——不過考慮到小型模型近年來因其易用性而大受歡迎,這個範圍已相當實用。

- 標題中的「8 倍加速」是指 attention 計算,而非端到端推論。

- 某位早期實作者發現 QJL 誤差修正元件相當棘手,若實作有誤會產生垃圾輸出,必須嚴格遵照論文的非對稱估計器設計。

為什麼這很重要:效率競賽

TurboQuant 並非第一個試圖解決 AI 效率問題的嘗試。GGUF 量化已讓兩年前需要資料中心才能跑的模型能在本地執行;Speculative Decoding、Flash Attention、PagedAttention 也各自從不同角度削減了運算需求。

但趨勢很清楚,而且還在加速。AI 的下一個重要戰場不只是「誰的模型更大」,而是「誰的模型更高效、更能在邊緣裝置和一般硬體上執行」。

TurboQuant 在這個方向上是一記有力的出拳。即使 Google 不開源官方程式碼,社群也已在自己動手了。

真正值得盯的不是論文數字,而是社群的重現速度

TurboQuant 的技術結果確實漂亮——3-bit 量化零精度損失、大海撈針滿分、H100 上 attention 加速 8 倍——但這類數字在 AI 論文裡並不罕見。真正讓這篇值得關注的,是論文上線到社群獨立重現之間的時間差:幾個小時。

Google Research 部落格文章一發出,就有人從論文裡的數學自己寫 PyTorch、MLX 和 llama.cpp 實作,而且跑出來的壓縮比和準確度跟論文吻合。這說明兩件事:第一,論文裡的方法確實是可重現的,不是只有 Google 內部特殊環境才跑得出來;第二,開源社群對這類基礎設施級優化的反應速度,已經快到不需要等官方釋出程式碼。

不過也有幾個需要冷靜看的地方。原文標題的「8 倍加速」指的是 attention 計算,不是端到端推論。實際使用場景裡,模型效能受限的因素很多,KV Cache 壓縮能帶來的整體加速,可能遠小於 8 倍這個數字所暗示的。此外,Google 自己的實驗只測到 80 億參數以下的模型,更大規模能不能乾淨地套用,目前還是未知數。

更值得思考的是 TurboQuant 所代表的產業方向。AI 圈的主流敘事仍然是「更大更強」:更多參數、更長 context、更大 GPU 叢集。但 TurboQuant、GGUF 量化、Flash Attention、Speculative Decoding 這些工作共同指向另一條路線——用更少資源做同樣的事。對本地端 AI、邊緣裝置部署和那些付不起雲端推論費的團隊來說,這條路線可能比下一個兆參數模型更實際也更重要。

簡單講:TurboQuant 不是那種會上新聞頭條的突破,但如果你真的在跑本地模型、在做 RAG 管線、在算推論成本,這篇比大多數模型發表公告都更值得看。